大家好,我是不温卜火,是一名计算机学院大数据专业大二的学生,昵称来源于成语— 此篇为大家带来的是Spark环境搭建—standalone(1) 集群的搭建。 Spark是基于内存计算的大数据并行计算框架,实际中运行计算任务肯定是使用集群模式,那么我们先来学习Spark自带的standalone集群模式了解一下它的架构及运行机制。 假设集群中有三台节点,hadoop002,hadoop003,hadoop004 通过scp 命令将配置文件分发到其他机器上 本次的就到这里了, 好书不厌读百回,熟读课思子自知。而我想要成为全场最靓的仔,就必须坚持通过学习来获取更多知识,用知识改变命运,用博客见证成长,用行动证明我在努力。

不温不火,本意是希望自己性情温和。作为一名互联网行业的小白,博主写博客一方面是为了记录自己的学习过程,另一方面是总结自己所犯的错误希望能够帮助到很多和自己一样处于起步阶段的萌新。但由于水平有限,博客中难免会有一些错误出现,有纰漏之处恳请各位大佬不吝赐教!暂时只有csdn这一个平台,博客主页:https://buwenbuhuo.blog.csdn.net/

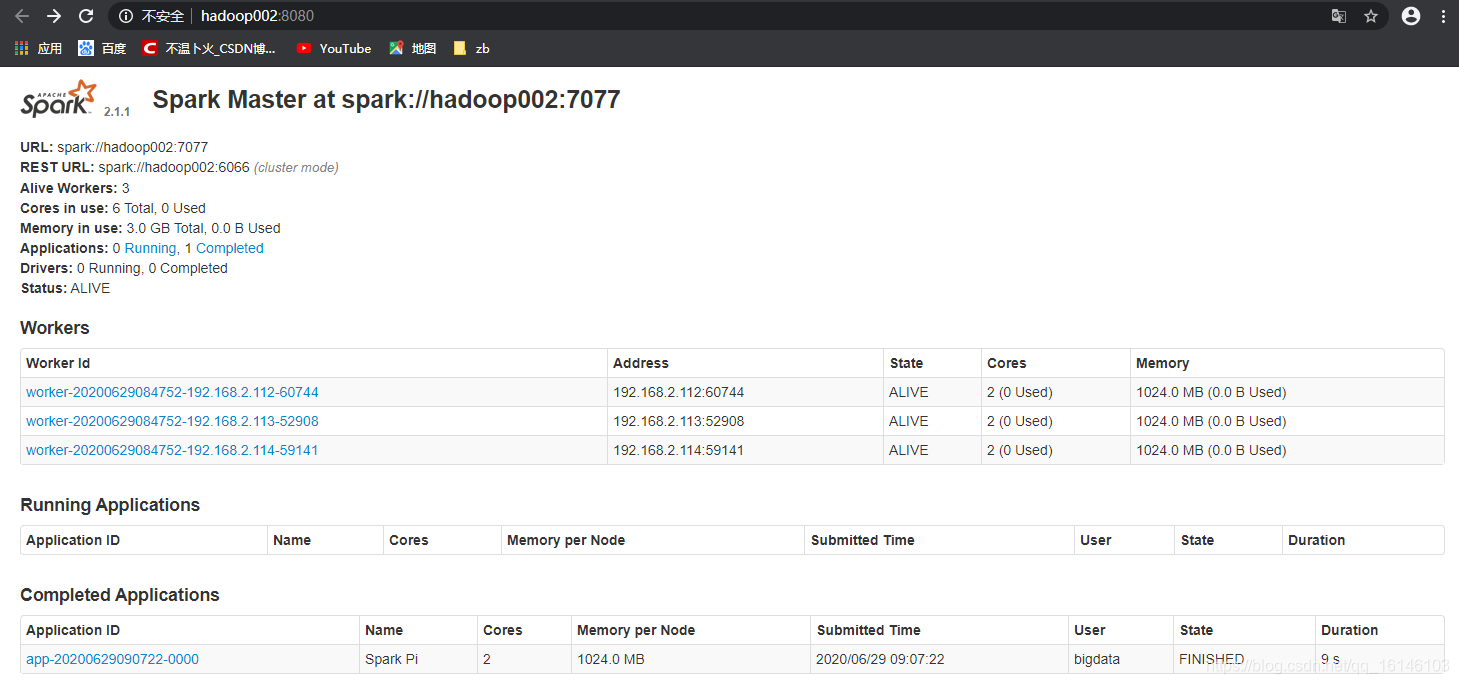

构建一个由 Master + Slave 构成的 Spark 集群,Spark 运行在集群中。

这个要和 Hadoop 中的 Standalone 区别开来. 这里的 Standalone 是指只用 Spark 来搭建一个集群, 不需要借助其他的框架.是相对于 Yarn 和 Mesos 来说的.一. 集群角色的简单介绍

二. 集群规划

hadoop002

master

hadoop003

slave/worker

hadoop004

slave/worker

三. 修改配置

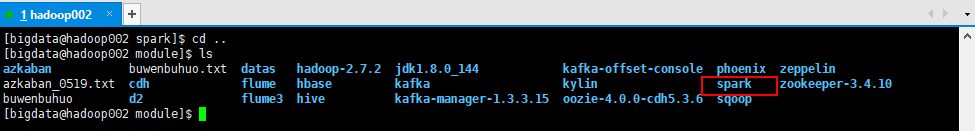

[bigdata@hadoop002 module]$ cp -r spark-2.1.1-bin-hadoop2.7 spark

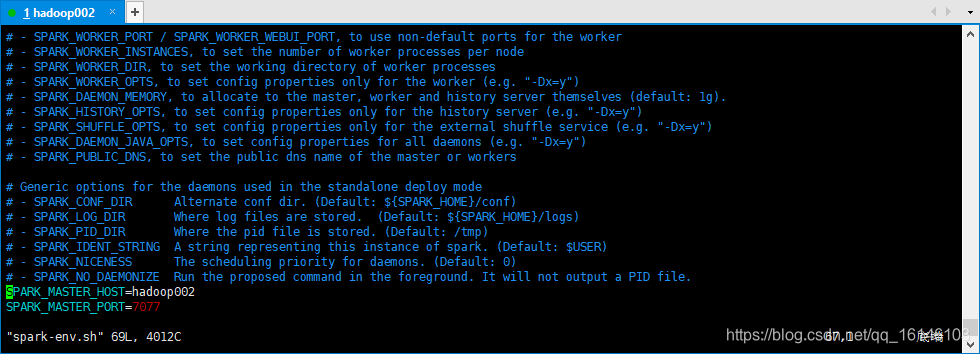

[bigdata@hadoop002 spark-standalone]$ cd conf/ [bigdata@hadoop002 conf]$ cp spark-env.sh.template spark-env.sh [bigdata@hadoop002 conf]$ vim spark-env.sh #指定默认master的ip或主机名 export SPARK_MASTER_HOST=hadoop002 #指定maaster提交任务的默认端口为7077 export SPARK_MASTER_PORT=7077

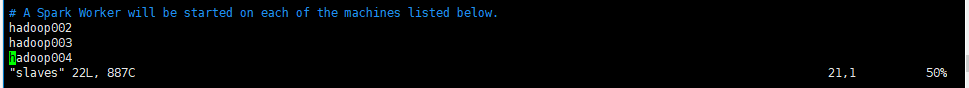

[bigdata@hadoop002 conf]$ cp slaves.template slaves [bigdata@hadoop002 conf]$ vim slaves # 在slaves文件中配置如下内容: hadoop002 hadoop003 hadoop004

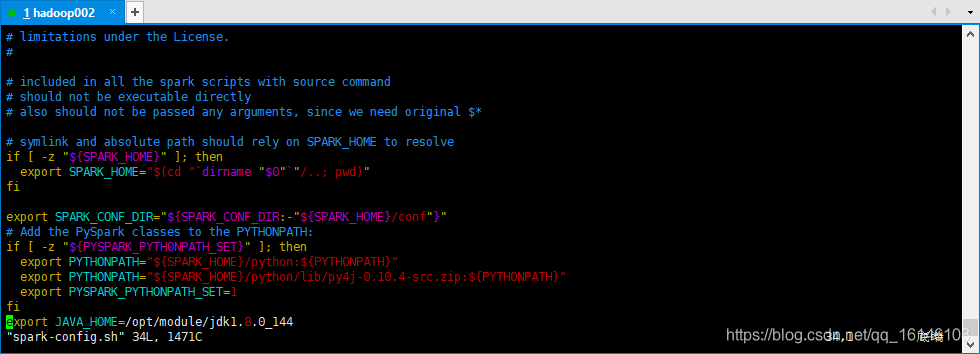

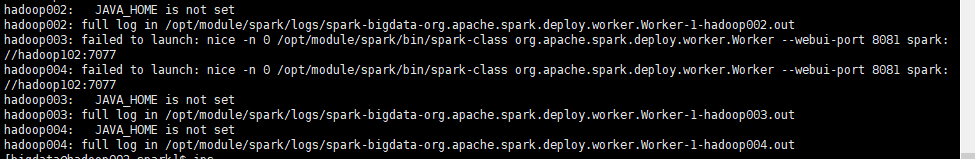

sbin/spark-config.sh中添加入JAVA_HOME变量export JAVA_HOME=/opt/module/jdk1.8.0_144

此处如果不添加会出现如下错误:

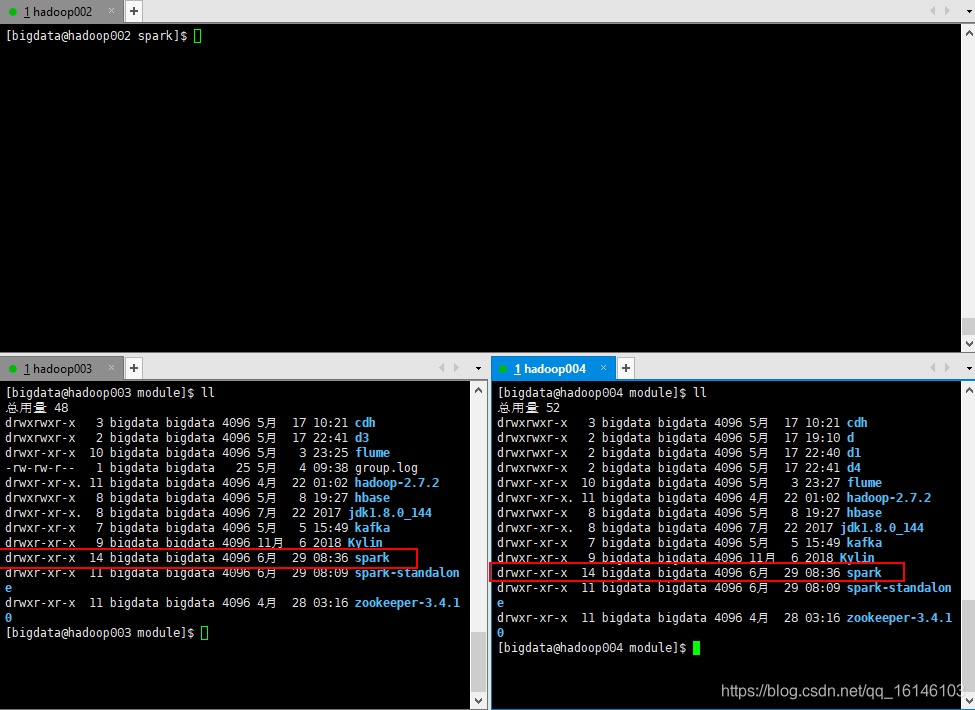

sparkscp -r /opt/module/spark hadoop003:/opt/module/ scp -r /opt/module/spark hadoop004:/opt/module/

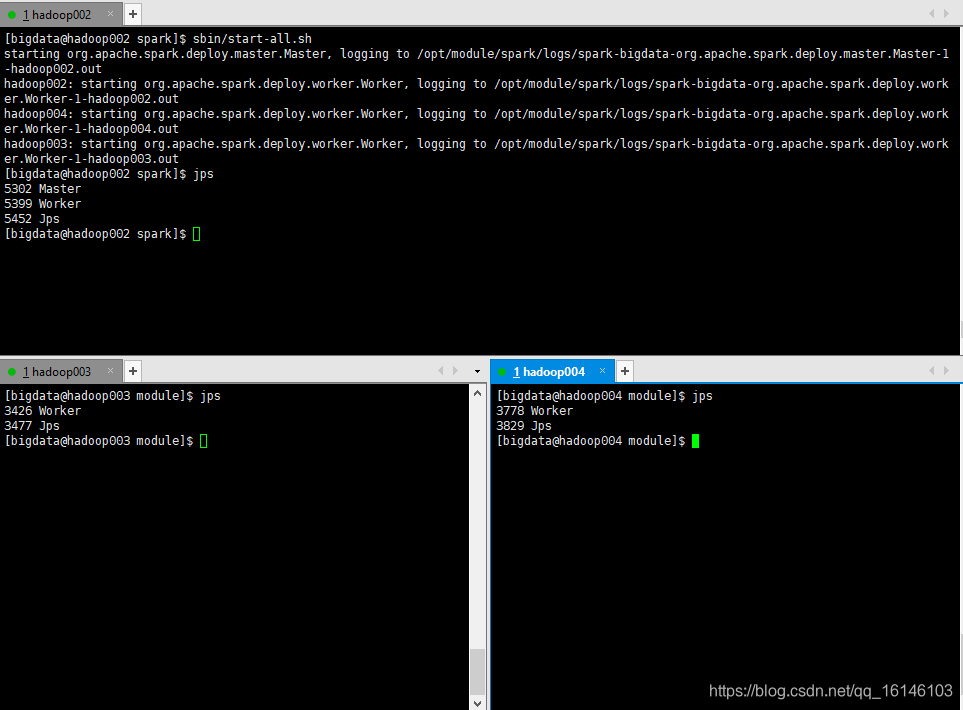

[bigdata@hadoop002 spark]$ sbin/start-all.sh

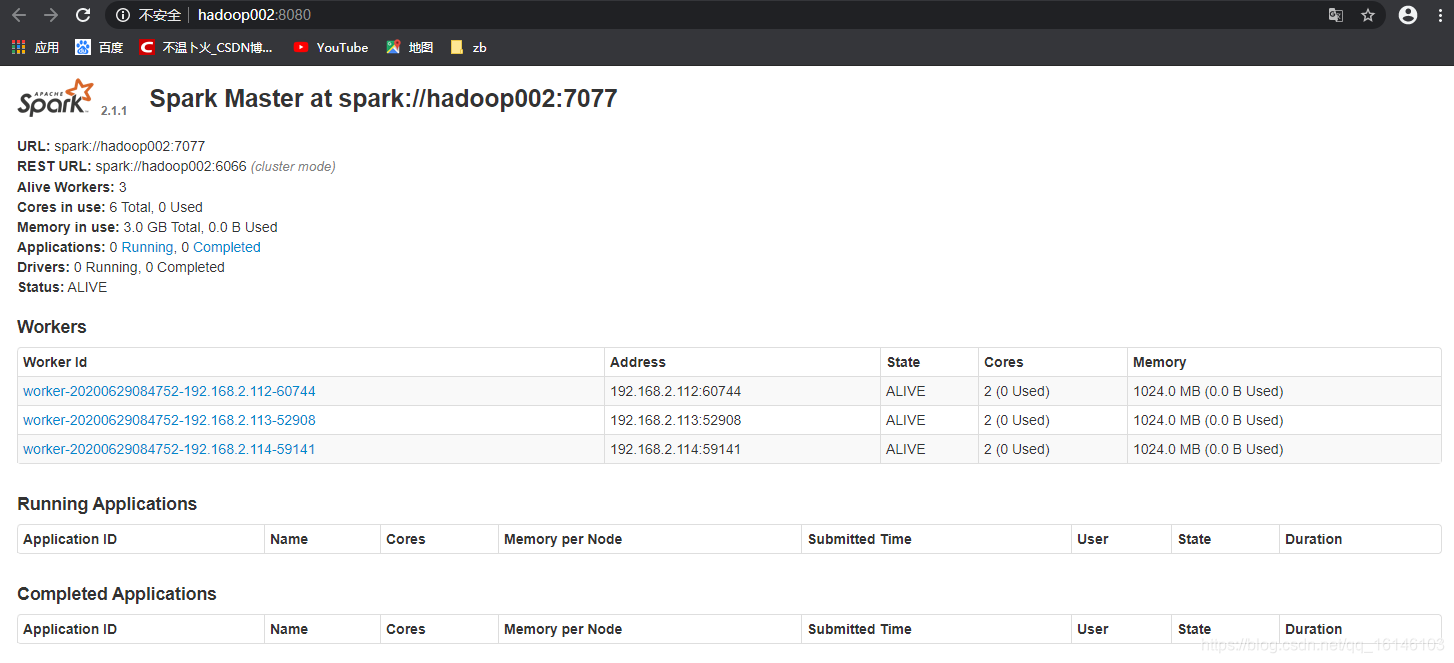

地址: https://hadoop002:8080

[bigdata@hadoop002 spark]$ bin/spark-submit --class org.apache.spark.examples.SparkPi --master spark://hadoop002:7077 --executor-memory 1G --total-executor-cores 2 ./examples/jars/spark-examples_2.11-2.1.1.jar 100

完成上述的操作 standalone集群模式就算是大概完成了。四. 修改事项(修改记得所有的都要哦)

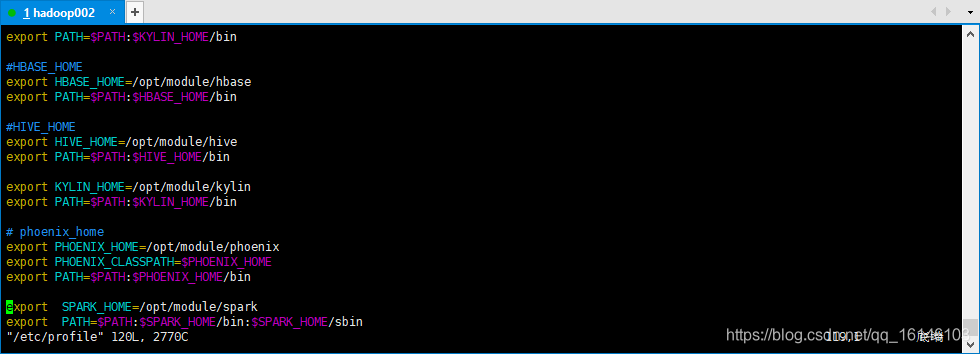

[bigdata@hadoop002 spark]$ sudo vim /etc/profile 配置spark环境变量(建议不添加,避免和Hadoop的命令冲突) export SPARK_HOME=/opt/module/spark export PATH=$PATH:$SPARK_HOME/bin:$SPARK_HOME/sbin [bigdata@hadoop002 spark]$ source /etc/profile 解决方案:

// 通过scp 命令将配置文件分发到其他机器上 scp /etc/profile root@hadoop003:/etc scp /etc/profile root@hadoop004:/etc source /etc/profile 五. 集群的启动和停止

在主节点上启动Spark集群 /export/servers/spark/sbin/start-all.sh 在主节点上停止spark集群 /export/servers/spark/sbin/stop-all.sh

在 master 安装节点上启动和停止 master: start-master.sh stop-master.sh 在 Master 所在节点上启动和停止worker(work指的是slaves 配置文件中的主机名) start-slaves.sh stop-slaves.sh

如果我的博客对你有帮助、如果你喜欢我的博客内容,请“” “评论”“”一键三连哦!听说的人运气不会太差,每一天都会元气满满呦!如果实在要白嫖的话,那祝你开心每一天,欢迎常来我博客看看。

码字不易,大家的支持就是我坚持下去的动力。后不要忘了关注我哦!

本网页所有视频内容由 imoviebox边看边下-网页视频下载, iurlBox网页地址收藏管理器 下载并得到。

ImovieBox网页视频下载器 下载地址: ImovieBox网页视频下载器-最新版本下载

本文章由: imapbox邮箱云存储,邮箱网盘,ImageBox 图片批量下载器,网页图片批量下载专家,网页图片批量下载器,获取到文章图片,imoviebox网页视频批量下载器,下载视频内容,为您提供.

阅读和此文章类似的: 全球云计算

官方软件产品操作指南 (170)

官方软件产品操作指南 (170)