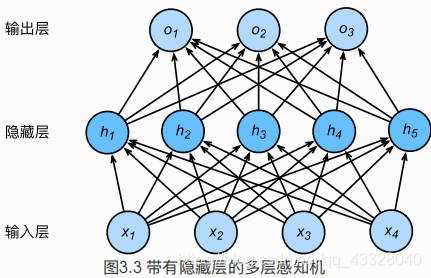

多层感知机(multilayer perceptron, MLP) 在单层神经网络的基础上引入了一到多个隐藏层(hidden layer)。隐藏层位于输入层和输出层之间。图3.3展示了一个多层感知机的神经网络图,它含有一个隐藏层,该层中有5个隐藏单元。 在图3.3所示的多层感知机中,输入和输出个数分别为4和3,中间的隐藏层中包含了5个隐藏单元(hidden unit)。由于输入层不涉及计算,图3.3中的多层感知机的层数为2。由图3.3可见,隐藏层中的神经元和输入层中各个输入完全连接,输出层中的神经元和隐藏层中的各个神经元也完全连接。因此,多层感知机中的隐藏层和输出层都是全连接层。 具体来说,给定一个小批量样本 我们先来看一种含单隐藏层的多层感知机的设计。其输出 也就是将隐藏层的输出直接作为输出层的输入。如果将以上两个式子联立起来,可以得到 从联立后的式子可以看出,虽然神经网络引入了隐藏层,却依然等价于一个单层神经网络:其中输出层权重参数为 上述问题的根源在于全连接层只是对数据做仿射变换(affine transformation),而多个仿射变换的叠加仍然是一个仿射变换。解决问题的一个方法是引入非线性变换,例如对隐藏变量使用按元素运算的非线性函数进行变换,然后再作为下一个全连接层的输入。这个非线性函数被称为激活函数(activation function)。下面我们介绍几个常用的激活函数。 ReLU(rectified linear unit)函数提供了一个很简单的非线性变换。给定元素 可以看出,ReLU函数只保留正数元素,并将负数元素清零。为了直观地观察这一非线性变换,我们先定义一个绘图函数 我们接下来通过 显然,当输入为负数时,ReLU函数的导数为0;当输入为正数时,ReLU函数的导数为1。尽管输入为0时ReLU函数不可导,但是我们可以取此处的导数为0。下面绘制ReLU函数的导数。 sigmoid函数可以将元素的值变换到0和1之间: sigmoid函数在早期的神经网络中较为普遍,但它目前逐渐被更简单的ReLU函数取代。在后面“循环神经网络”一章中我们会介绍如何利用它值域在0到1之间这一特性来控制信息在神经网络中的流动。下面绘制了sigmoid函数。当输入接近0时,sigmoid函数接近线性变换。 依据链式法则,sigmoid函数的导数 下面绘制了sigmoid函数的导数。当输入为0时,sigmoid函数的导数达到最大值0.25;当输入越偏离0时,sigmoid函数的导数越接近0。 tanh(双曲正切)函数可以将元素的值变换到-1和1之间: 我们接着绘制tanh函数。当输入接近0时,tanh函数接近线性变换。虽然该函数的形状和sigmoid函数的形状很像,但tanh函数在坐标系的原点上对称。 依据链式法则,tanh函数的导数 下面绘制了tanh函数的导数。当输入为0时,tanh函数的导数达到最大值1;当输入越偏离0时,tanh函数的导数越接近0。 多层感知机就是含有至少一个隐藏层的由全连接层组成的神经网络,且每个隐藏层的输出通过激活函数进行变换。多层感知机的层数和各隐藏层中隐藏单元个数都是超参数。以单隐藏层为例并沿用本节之前定义的符号,多层感知机按以下方式计算输出: 其中 我们已经了解了多层感知机的原理。下面,我们一起来动手实现一个多层感知机。首先导入实现所需的包或模块。 这里继续使用Fashion-MNIST数据集。我们将使用多层感知机对图像进行分类。 输入个数为784,输出个数为10。实验中,我们设超参数隐藏单元个数为256。 这里我们使用基础的 同softmax回归一样,我们通过 为了得到更好的数值稳定性,我们直接使用PyTorch提供的包括softmax运算和交叉熵损失计算的函数。 我们在这里设超参数迭代周期数为5,学习率为100.0。 输出:

文章目录

1. 隐藏层

X∈Rn×d,其批量大小为

n,输入个数为

d。假设多层感知机只有一个隐藏层,其中隐藏单元个数为

h。记隐藏层的输出(也称为隐藏层变量或隐藏变量)为

H,有

H∈Rn×h。因为隐藏层和输出层均是全连接层,可以设隐藏层的权重参数和偏差参数分别为

Wh∈Rd×h和

bh∈R1×h,输出层的权重和偏差参数分别为

Wo∈Rh×q和

bo∈R1×q。

O∈Rn×q的计算为

HO=XWh+bh,=HWo+bo,

O=(XWh+bh)Wo+bo=XWhWo+bhWo+bo.

WhWo,偏差参数为

bhWo+bo。不难发现,即便再添加更多的隐藏层,以上设计依然只能与仅含输出层的单层神经网络等价。2. 激活函数

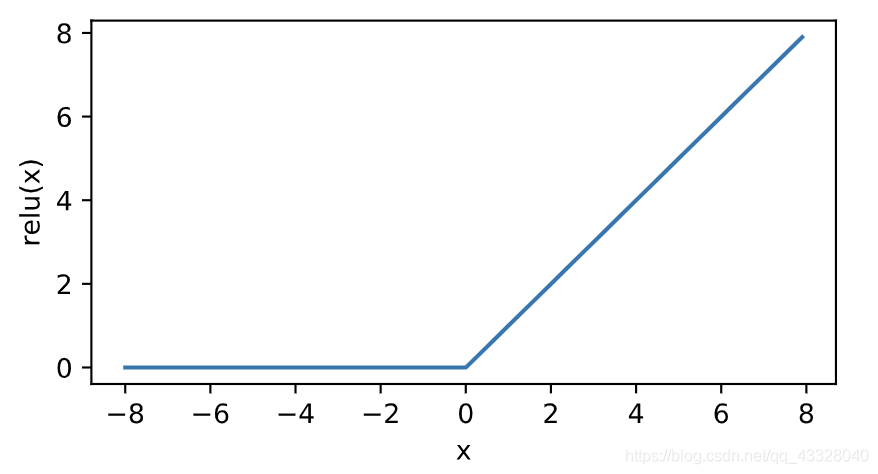

2.1 ReLU函数

x,该函数定义为

ReLU(x)=max(x,0).xyplot。%matplotlib inline import torch import numpy as np from IPython import display import matplotlib.pylab as plt import sys sys.path.append("..") print(torch.__version__) def xyplot(x_vals, y_vals, name): display.set_matplotlib_formats('svg') plt.rcParams['figure.figsize'] = (5, 2.5) plt.plot(x_vals.detach().numpy(), y_vals.detach().numpy()) plt.xlabel('x') plt.ylabel(name + '(x)') Tensor提供的relu函数来绘制ReLU函数。可以看到,该激活函数是一个两段线性函数。x = torch.arange(-8.0, 8.0, 0.1, requires_grad=True) y = x.relu() xyplot(x, y, 'relu')

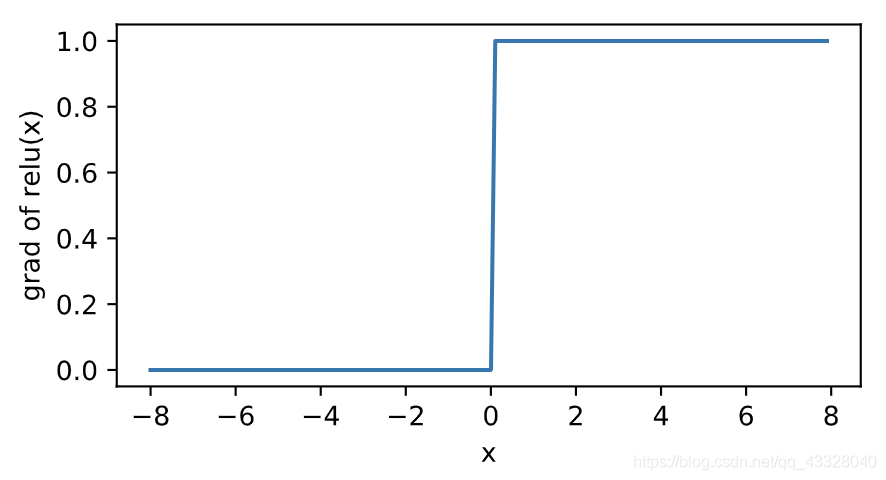

y.sum().backward() xyplot(x, x.grad, 'grad of relu')

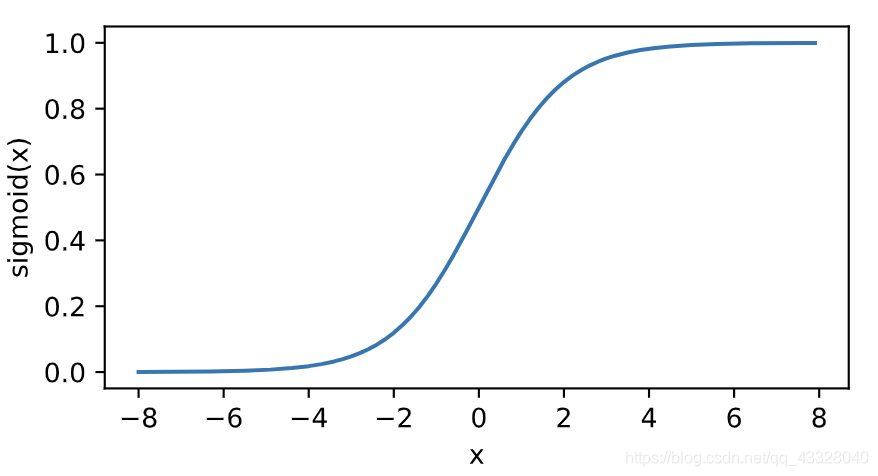

2.2 sigmoid函数

sigmoid(x)=1+exp(−x)1.y = x.sigmoid() xyplot(x, y, 'sigmoid')

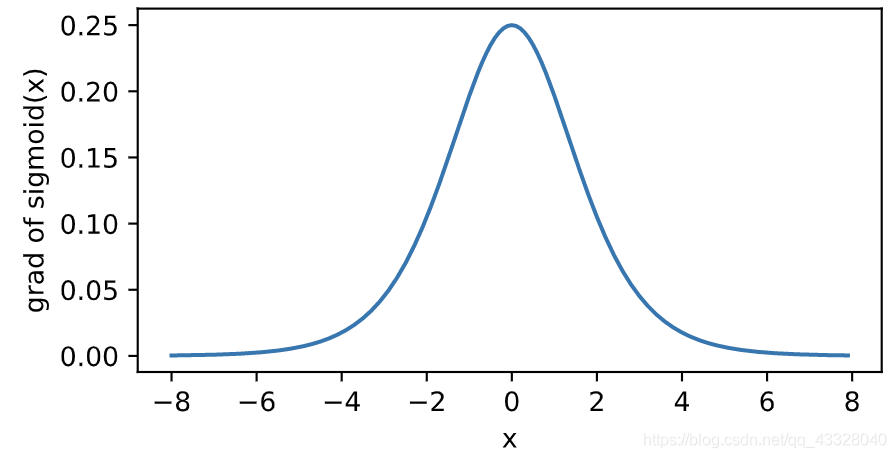

sigmoid′(x)=sigmoid(x)(1−sigmoid(x)).x.grad.zero_() y.sum().backward() xyplot(x, x.grad, 'grad of sigmoid')

2.3 tanh函数

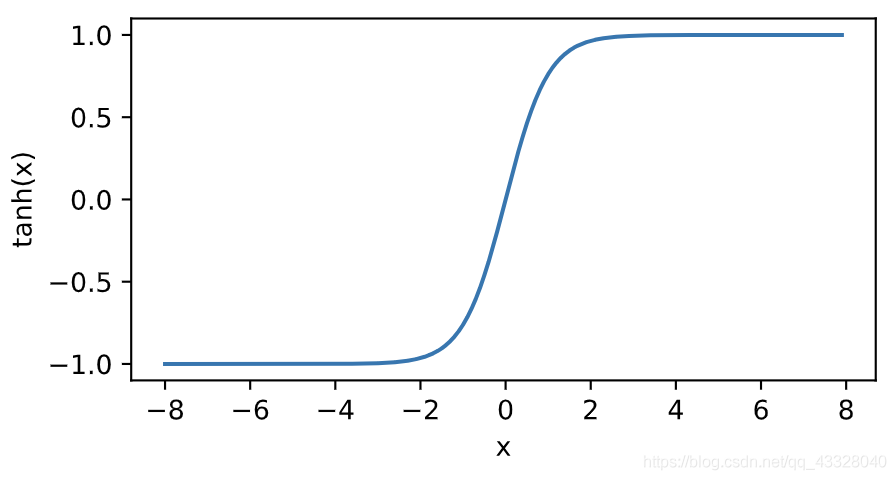

tanh(x)=1+exp(−2x)1−exp(−2x).y = x.tanh() xyplot(x, y, 'tanh')

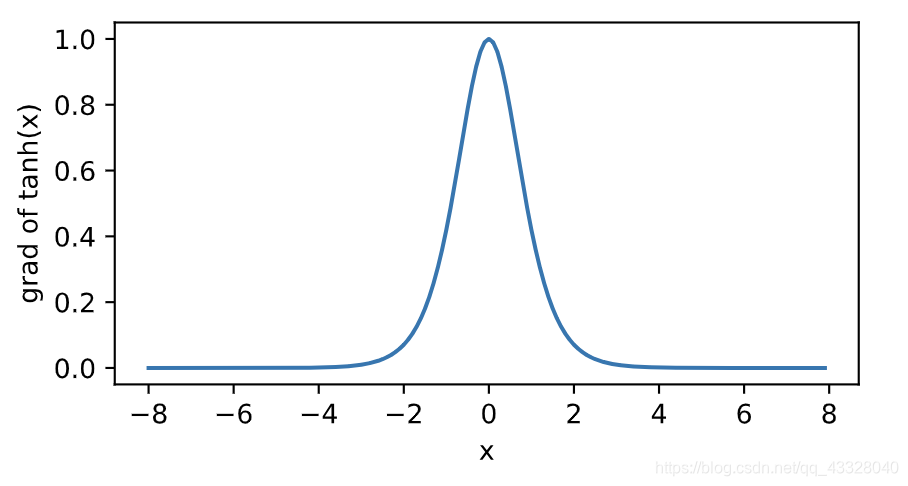

tanh′(x)=1−tanh2(x).x.grad.zero_() y.sum().backward() xyplot(x, x.grad, 'grad of tanh')

3 多层感知机

HO=ϕ(XWh+bh),=HWo+bo,

ϕ表示激活函数。在分类问题中,我们可以对输出

O做softmax运算,并使用softmax回归中的交叉熵损失函数。

在回归问题中,我们将输出层的输出个数设为1,并将输出

O直接提供给线性回归中使用的平方损失函数。4. 代码实现MLP

import torch import numpy as np import sys sys.path.append("..") import d2lzh_pytorch as d2l 4.1 获取和读取数据

batch_size = 256 train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size) 4.2 定义模型参数

num_inputs, num_outputs, num_hiddens = 784, 10, 256 W1 = torch.tensor(np.random.normal(0, 0.01, (num_inputs, num_hiddens)), dtype=torch.float) b1 = torch.zeros(num_hiddens, dtype=torch.float) W2 = torch.tensor(np.random.normal(0, 0.01, (num_hiddens, num_outputs)), dtype=torch.float) b2 = torch.zeros(num_outputs, dtype=torch.float) params = [W1, b1, W2, b2] for param in params: param.requires_grad_(requires_grad=True) 4.3 定义激活函数

max函数来实现ReLU,而非直接调用relu函数。def relu(X): return torch.max(input=X, other=torch.tensor(0.0)) 4.4 定义模型

view函数将每张原始图像改成长度为num_inputs的向量。然后我们实现上一节中多层感知机的计算表达式。def net(X): X = X.view((-1, num_inputs)) H = relu(torch.matmul(X, W1) + b1) return torch.matmul(H, W2) + b2 4.5 定义损失函数

loss = torch.nn.CrossEntropyLoss() 4.6 训练模型

def sgd(params, lr, batch_size): for param in params: param.data -= lr * param.grad / batch_size # 注意这里更改param时用的param.data def evaluate_accuraacy(data_iter, net): acc_sum, n = 0.0, 0 for X, y in data_iter: acc_sum += (net(X).argmax(dim=1) == y).float().sum().item() n += y.shape[0] return acc_sum / n def train_ch3(net, train_iter, test_iter, loss, num_epochs, batch_size, params=None, lr=None, optimizer=None): for epoch in range(num_epochs): train_l_sum, train_acc_sum, n = 0.0, 0.0, 0 for X, y in train_iter: y_hat = net(X) l = loss(y_hat, y).sum() # 梯度清零 if optimizer is not None: optimizer.zero_grad() elif params is not None and params[0].grad is not None: for param in params: param.grad.data.zero_() l.backward() if optimizer is None: sgd(params, lr, batch_size) else: optimizer.step() # “softmax回归的简洁实现”一节将用到 train_l_sum += l.item() train_acc_sum += (y_hat.argmax(dim=1) == y).sum().item() n += y.shape[0] test_acc = evaluate_accuraacy(test_iter, net) print('epoch %d, loss %.4f, train acc %.3f, test acc %.3f' % (epoch + 1, train_l_sum / n, train_acc_sum / n, test_acc)) num_epochs, lr = 5, 100.0 train_ch3(net, train_iter, test_iter, loss, num_epochs, batch_size, params, lr) epoch 1, loss 0.0030, train acc 0.714, test acc 0.753 epoch 2, loss 0.0019, train acc 0.821, test acc 0.777 epoch 3, loss 0.0017, train acc 0.842, test acc 0.834 epoch 4, loss 0.0015, train acc 0.857, test acc 0.839 epoch 5, loss 0.0014, train acc 0.865, test acc 0.845 小结

本网页所有视频内容由 imoviebox边看边下-网页视频下载, iurlBox网页地址收藏管理器 下载并得到。

ImovieBox网页视频下载器 下载地址: ImovieBox网页视频下载器-最新版本下载

本文章由: imapbox邮箱云存储,邮箱网盘,ImageBox 图片批量下载器,网页图片批量下载专家,网页图片批量下载器,获取到文章图片,imoviebox网页视频批量下载器,下载视频内容,为您提供.

阅读和此文章类似的: 全球云计算

官方软件产品操作指南 (170)

官方软件产品操作指南 (170)